别让AI替你说出那句「我觉得」

摘要

AI的本质是鼓励人们少思考,其很多功能如一键总结、自动归类、智能推荐等是在降低认知负担,虽然提高了效率,但也引导人们放弃主动筛选和判断的过程,容易让人养成“等待答案”的习惯,进而导致自主分析信心下降、独立推理出现困难,大脑变得迟钝,批判性思维能力被弱化。

谷歌脑成像研究发现经常使用AI的人大脑前额叶活跃度下降、海马体体积缩小,以及亚马逊客服员工使用AI辅助后处理投诉能力下降等,但通过进一步查证发现这些所谓的“研究”并不存在,数据也无明确出处,从而指出人们在频繁使用AI时,容易不加质疑地接受看似合理但未经证实的说法。

一方面,AI作为“记忆外挂”让人们不再重视记忆基础概念,而理解复杂内容是需要建立在对基础概念记忆的基础上的,这使得人们丢掉了理解世界的基本支点;另一方面,经验正在变成“压缩胶囊”,人们习惯把经验存进AI,遇到问题就调用,而那些需要手感、直觉、真实经历去打磨的经验是AI替代不了的,真正厉害的人是能将“手感”和“AI工具箱”结合起来的人。

在效率优先的时代,人们应该找回“慢思考”,考虑工具理性的边界,对抗多巴胺驱动的认知惯性,给自己留怀疑的空间,因为慢的本质是一种AI给不了的元能力。同时,人要找到与技术共处时自己的角色位置,带着自主性和创造力去使用技术,守住自己的判断权,避免被技术同化,未来理性体现在能否守住判断权。

好像我们越来越倾向于,先看AI输出的内容,再进行二次加工和优化。

昨天凌晨,ChatGPT推出新功能,我突然冒出一个想法:过去决策流程是:人先看内容,再做判断,最后执行;现在,先提出问题,AI给出建议,再确认方向,接着一步步推进下去。

AI正在重构对信息的处理方式,它在帮我们决定:哪些信息应该优先被看到,哪些内容更有价值,哪些观点值得深入探讨。

这让我突然意识到一个问题:我们是否正在亲手制造一种“认知外包”的依赖?

我觉得:是。毋庸置疑,AI设计的本质是鼓励人们少思考。现在许多AI产品底层逻辑就是“降低认知负担”,比如一键总结、自动归类、智能推荐等等。

这些功能确实提高了效率,但也在无形中引导我们放弃主动筛选和判断的过程。

我就是一个例子。经常使用 Notion AI,在没有 AI 之前和有了 AI 之后,行为发生了明显的变化。

以前很多信息的筛选、整理,都是亲自搞定;现在不需要了。不用自己动手之后,我发现注意力开始变得散漫,思维也不再像过去那样有强烈的动力。

我现在会习惯性地先把内容丢给 AI 粗略过一遍,觉得有点价值,就直接导入文档。等要进一步处理时,再继续向 AI 提问。

这个过程潜移默化地训练我变成了一个“等待答案”的人,这种“认知外包”确实很舒服,但也藏着陷阱:一旦用习惯了,就很难回头。

我们的大脑天生喜欢走最省力的路径,而 AI 正好提供了这样一种“低能耗”的认知方式。

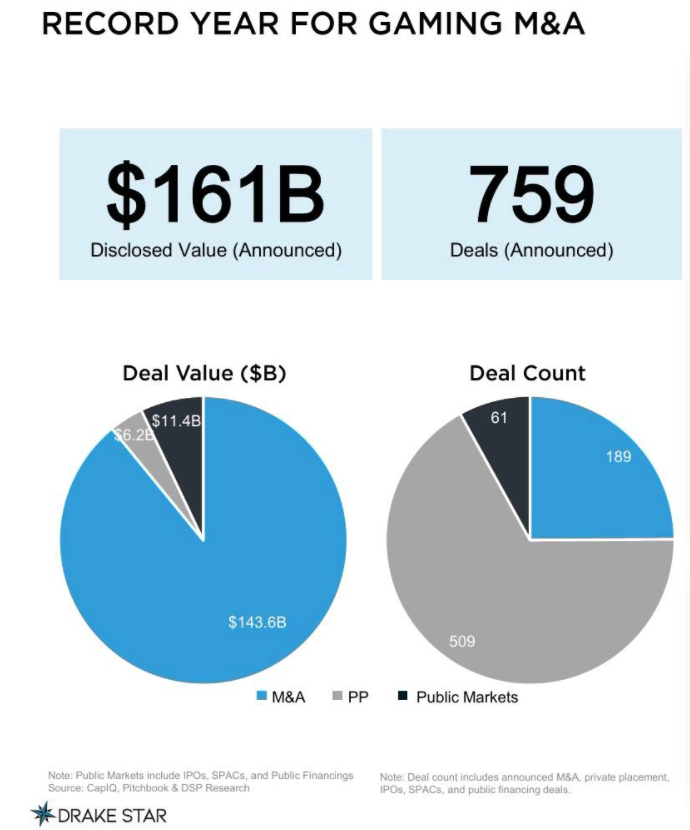

已经有研究指出,随着人们对 AI 工具信任度的提升,越来越多的人,倾向于把认知任务交给它,从而减少对信息的深入加工;这会导致我们在面对复杂问题时,自主分析的信心大幅下降。

虽然目前没有明确的数据,说明具体下降比例,但趋势已经很明显;还有不少研究发现,频繁依赖 AI 的人,在独立推理方面确实会出现困难。

不知道别人怎么样,但我能明显感觉到,脑子比没有 AI 的时要迟钝一些。

除此之外,公司也在系统性地推动这种“认知外包”;不惜一切代价把 AI 嵌入到工作流程中,比如 AI 客服、AI 做 PPT,……这些看似提升了效率,实则也在悄然弱化我们的批判性思维能力。

不过,我不完全否定认知外包的价值,只是它的边界正在被迅速侵蚀。

前几天跟一位大学教授聊天,他说现在很多学生都用 AI 来做学术分析、资料收集,搞得老师也很被动,只能反过来用 AI 检查论文质量、分析查重比例。

你说这不是一件很荒谬的事吗?表面上看是加速了一切,结果反而让一切都变得更忙、更混乱。

我们也聊到了一个更深层的问题:什么时候该用 AI 帮忙,什么时候又必须坚持人的判断?这个问题,最终也没有答案。

但从我的角度来说,会尽量做到“能外包,不思考”,不是因为懒,是这非常符合人的天性:我们都渴望轻松,而 AI是一个不断递“捷径”的朋友。

既然认知外包无法阻挡,那这种行为会不会固化?会不会反噬我们?我不是为了证明“AI会让人变笨”这个结论,是想还原一个真实的现象。

当我开始思考这个问题时,故意把问题分别丢给了豆包、夸克、DeepSeek。结果,答案令我大吃一惊。

DeepSeek 就说:

Google 做过脑成像研究发现,经常使用 AI 的人,大脑前额叶活跃度下降 30%,海马体体积缩小 8%;前额叶是我们做判断、做决策最重要的区域,这部分“懒”了,人的判断力就会退化。

它还补充道:

加州大学的研究也发现,AI 总是快速给答案,会刺激大脑分泌多巴胺,就像打游戏赢了那样爽。

时间一长,人就会上瘾,越来越依赖 AI。亚马逊客服员工用了 AI 辅助之后,半年内自己处理投诉的能力下降了34%。

这些说法听起来是不是挺有道理的?如果你平时不习惯质疑 AI 输出的内容,可能看到这就信了。

但我没有放弃。去查了所谓的“研究”,却发现:根本没有这项研究;我又换了个学术型 AI 工具再查了一遍,还是没找到出处。

接着又用 Gemini 搜了搜关于谷歌客服、亚马逊客服员工能力变化的数据,也没有明确支持那个 34% 下降的说法,只有对现象的一些描述。

所以,我想说什么?

我们以为自己在获取知识,可能只是在接受一套“看似合理”的说法;当我们在频繁使用 AI 的过程中,慢慢习惯了它给的答案,就会越来越少地去怀疑、去验证、去独立思考。

这就像开车导航久了,你就忘了怎么看地图;用计算器多了,心算能力也就退化了。不是 AI 有意害我们,而是我们正在不知不觉中,把原本属于自己的思考能力,一点点交出去了。

说到底,认知外包到底会不会造成行为固化?我不敢下定论。但可以确定的是,它让深度思考变得越来越稀缺。

不对,也不能叫“深度思考力”下降,准确来说,是创意、洞察、质疑、重构的能力正在被削弱。这些不是 AI 不能做,是我们正一点点把“人之所以为人”的能力,交给了 AI 去完成。

昨天一个同学还跟我说:

以前做品牌推广,团队要围在一起头脑风暴:用户到底在意什么?痛点在哪?有没有新的表达方式?

现在呢?第一反应变成了:“先让 AI 出几个方案看看。”

然后把方案拿回来优化一下,再发给甲方。至于甲方是不是也用 AI 在看这些创意?没人知道,但谁也不敢排除这个可能。

你看,结构统一了、话术相似了、创意也变得“安全”了;表面上效率提升了,但真正从那种混乱中诞生的新想法,却越来越少了。而这,才是最值得警惕的地方。

写到这儿,我在想:当 AI 成为“记忆外挂”,我们还剩下什么?

过去记住东西是一种负担,是大脑在“存储数据”。现在,AI可以帮我们记下一切:看到的、听到的、经历过的,只要拍张照、录段音、打句话,它就能替我们记住。

于是我开始相信:我不需要记得那么细,只要知道基础概念就行,但问题是:理解从来不是凭空发生的。

我只有真正记得住基本的东西,才能听懂、看懂、想明白更复杂的内容。

如果我连“什么是因果”、“什么是前提条件”都要靠 AI 提醒,那所谓的“复杂推演”,也不过是在调用模型输出的结果罢了。

换句话说,我不是卸下了记忆的负担,而是在不知不觉中,丢掉了理解世界的基本支点;所以,“理解”本身,其实才是前置条件。

另外,我个人认为,经验正在变成一种“压缩胶囊”。

过去做项目、写方案、处理问题,靠反复打磨和长期积累;这些经验沉淀在脑子里,变成了判断力、方法论,甚至直觉。

现在,越来越习惯于把经验存进 AI 里。遇到问题时,第一反应是让 AI“生成一个类似场景的解决方案”;于是,经验可能不再是一种内化的积累,而变成了工具箱里的配件:想用就调出来。

但这带来一个问题:那些需要手感、直觉、真实经历过的经验,AI能替代吗?我认为不能。

不信你看:

以前去看感冒,医生会摸一摸额头、听听肺音、问清楚症状,再结合自己的临床经验开药。这种“凭感觉”的判断,是多年积累出来的,不是照搬指南就能掌握的。

再比如:设计师改稿,AI可以先排个样式,挑一个差不多的进行优化,但美学、品牌调性、要考虑用户使用场景等抽象的东西,它给不了。这活学活用的经验。

所以,有些经验,必须靠手感、靠直觉、靠一次次试错去打磨,有些直接调用,而前者会成为一种稀缺;换言之,真正厉害的人,是能把“手感”和“AI工具箱”结合起来的人。

我认为,效率优先的时代,我们是不是该找回以往那种“慢思考”?也该考虑一下,工具理性的边界到底在哪?

慢下来这件事,不可能。整个系统都在逼着你快;工作流程要快、内容消费要快、做方案也要快,好像谁慢一步就落后了。

但我也在想一个问题:

如果我们都追求快,那还有没有人愿意花时间去“想明白”?以前我以为慢就是低效,现在有点改观了。慢不是为了拖时间,而是为了对抗多巴胺驱动的认知惯性。

我们太容易被AI“喂答案”,就像刷短视频一样,每次都能获得即时满足;满足背后是大脑在分泌多巴胺,它会让我们越来越依赖“快速反馈”,越来越不愿意自己动脑。

久而久之,神经元连接方式也会变,越来越倾向于“选A还是B”,而不是“这题有没有问错”;所以我说,慢是给自己留一点“怀疑的空间”。

还有一点,慢的本质是一种AI给不了的元能力。

前几天我刷到一个视频,一个大学老师在教学生提问,他说了一句话:今天的作业不需要你照本宣科地给我结论,我希望你能给出一个不一样的思考。

我当时听完就觉得挺有意思,因为这句话点出了一个很关键的问题:

每个人的破局点在哪?这个破局点可能是过程性思考。过程性思考算不算元能力呢?我不知道,至少每个人想的不同就对了。

欧盟那份《人机共生宣言》中有条铁律:

AI无权替人类回答为什么。

换句话说,终极边界法则可能是:AI能处理 what 和 how,但 why,必须由人来决定。

再回到工具理性上,大厂不可能停下对AGI的追求,但这不代表就只能跟着跑,我们也可以在工具理性当中,找一个人性的坐标。

什么是人的坐标?

我觉得,在与技术共处的过程中,要找到自己的角色位置;你可以这么看:过去我们是 AI 的制造者,现在我们是 AI 的使用者,也被它影响着。

那再往后呢?会不会出现一种新的角色:成为个人 AI 助理的守护者?我不知道。

但可以确定,这个坐标在不断变化;只有当每个人都开始意识到自己的位置,并带着自主性、创造力去使用技术时,才不会被技术所同化。

或许,未来理性,是我们是否能守住自己的判断权。