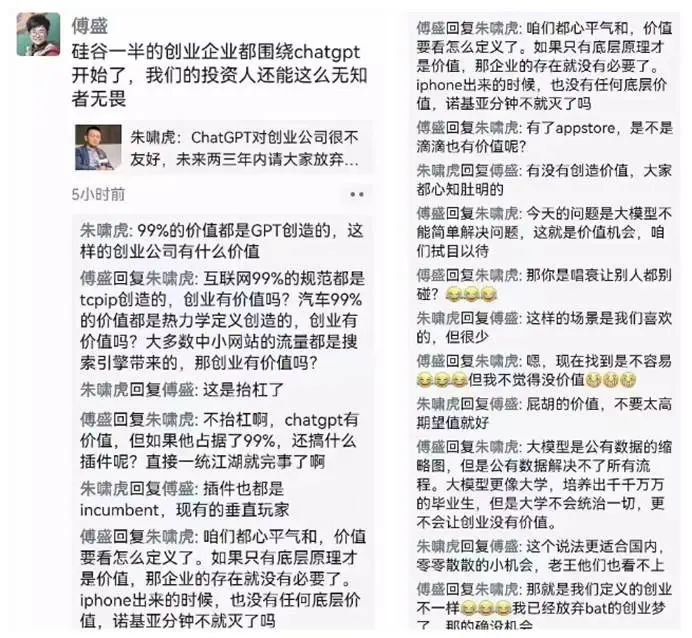

ElevenLabs的最强竞争对手,Sesame的语音模型真能媲美真人?

总部所在地:美国硅谷

时间线:公司成立于 2023 年,2025 年 2 月上线语音助手 Maya&Miles,2025 年 3 月推出 CSM 语音生成模型,并开源1B版本。

融资情况:2023 年 11 月 1 日,完成由 a16z 领投的 4750 万美元A轮融资,新一轮融资仍在洽谈中。

产品概述:语音助手及语音生成模型

2 月 28 日,Sesame 推出了 AI 语音助手 Maya(女性声音)&Miles(男性声音),该语音助手最大的差异点是主打真实和感情饱和,The Verge 在体验之后表示,它做得比其他所有语音助手都要好。

在 3 月 13 日,Sesame 又发布了 2 个语音助手背后的基础模型 CSM,该模型能够处理文本和音频输入,实现文本转语音和实时对话的效果,其基本架构是在 Meta 的 Llama 开源模型的基础上叠加 Sesame 自研的音频生成模型。目前CSM模型有三种不同规格,目前开源的是 10 亿参数的 Tiny 模型,还有 30 亿参数的 Small 模型和 80 亿参数的 Medium 模型。

测试方法:给 Sesame 文字内容,生成双人语音对话的音频

根据我们的测试结果,Sesame 模型不仅在自然度和情感方面做得非常好,还支持生成多人对话的语音内容,其多人对话场景的情感表达,与真人对话几乎无异。除此之外 CSM 模型还具备克隆声音、上下文感知能力和 2 分钟的对话记忆功能,其端到端延迟为 380 毫秒。虽然模型整体质量不错,但在多语言支持上,CSM 做的仍不太好,生成其他语言内容时,其质量显著低于英语内容。

除了语音助手与模型外,Sesame 还在开发搭载语音助手 Maya&Miles 的眼镜,进军硬件产业。